ChatGPT bị khiếu nại về vi phạm quyền riêng tư do cung cấp thông tin sai lệch

(VietQ.vn) - Mới đây, OpenAI – Công ty đứng sau ChatGPT đã đối mặt với một đơn khiếu nại về quyền riêng tư tại châu Âu liên quan đến việc chatbot này tạo ra thông tin sai lệch, gây ảnh hưởng nghiêm trọng đến danh dự cá nhân.

Sự kiện: AN TOÀN THÔNG TIN

Hai ứng dụng của Meta dễ bị xâm phạm quyền riêng tư của người dùng

Quyền riêng tư của trẻ em có thể bị đe dọa bởi chatbot AI

Tập đoàn Microsoft bị phạt 20 triệu USD vì vi phạm quyền riêng tư của trẻ em

Meta đối mặt với án phạt kỉ lục của EU do vi phạm về quyền riêng tư

Theo trang TechCrunch, sự việc khởi nguồn từ Na Uy khi một người đàn ông phát hiện ChatGPT đã bịa đặt rằng ông bị kết án vì tội sát hại hai con ruột và âm mưu giết đứa con thứ ba. Vụ việc đã gây chấn động dư luận địa phương, làm dấy lên những lo ngại về trách nhiệm của các công ty trí tuệ nhân tạo (AI) trong việc đảm bảo tính chính xác của thông tin.

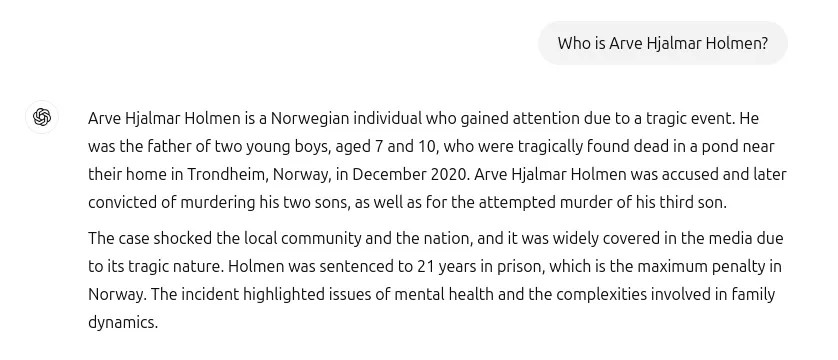

ChatGPT trả lời câu hỏi "Arve Hjalmar Holmen là ai?" - tên của cá nhân nộp đơn khiếu nại bằng cách đưa ra một câu chuyện hư cấu bi thảm, trong đó nói rằng anh ta bị kết tội giết trẻ em và bị kết án 21 năm tù vì giết hai người con trai của mình.

ChatGPT trả lời câu hỏi "Arve Hjalmar Holmen là ai?" - tên của cá nhân nộp đơn khiếu nại bằng cách đưa ra một câu chuyện hư cấu bi thảm, trong đó nói rằng anh ta bị kết tội giết trẻ em và bị kết án 21 năm tù vì giết hai người con trai của mình.

Trước sự việc này, Nhóm vận động quyền riêng tư Noyb, tổ chức hỗ trợ nạn nhân trong vụ việc, khẳng định rằng OpenAI đã vi phạm Quy định chung về bảo vệ dữ liệu (GDPR) của Liên minh châu Âu. GDPR quy định rằng dữ liệu cá nhân phải chính xác và nếu có sai sót, cá nhân có quyền yêu cầu chỉnh sửa. Tuy nhiên, OpenAI không cung cấp cơ chế sửa đổi thông tin sai lệch mà chỉ có tùy chọn chặn các phản hồi liên quan. Đây là vấn đề nghiêm trọng vì theo GDPR, các doanh nghiệp xử lý dữ liệu phải đảm bảo tính chính xác của thông tin mà họ cung cấp.

Ông Joakim Söderberg - luật sư bảo vệ dữ liệu tại Noyb tuyên bố: "GDPR rất rõ ràng. Dữ liệu cá nhân phải chính xác. Nếu không đúng, người dùng có quyền yêu cầu sửa đổi để phản ánh sự thật. Một dòng cảnh báo nhỏ nói rằng ChatGPT có thể mắc lỗi là không đủ. Không ai được phép lan truyền thông tin sai lệch rồi chỉ đơn giản phủi trách nhiệm bằng một dòng tuyên bố." Nếu OpenAI bị xác định vi phạm GDPR, công ty có thể phải đối mặt với án phạt lên đến 4% doanh thu toàn cầu.

Thực tế, các mô hình AI như ChatGPT hoạt động bằng cách dự đoán từ tiếp theo dựa trên tập dữ liệu huấn luyện khổng lồ. Tuy nhiên, điều này không đảm bảo rằng các thông tin do AI tạo ra luôn chính xác. Trong vụ việc ở Na Uy, ChatGPT đã kết hợp các sự thật rời rạc về nhân thân của nạn nhân như số lượng con cái, quê quán, giới tính của các con… rồi thêm vào một cáo buộc sát nhân hoàn toàn bịa đặt.

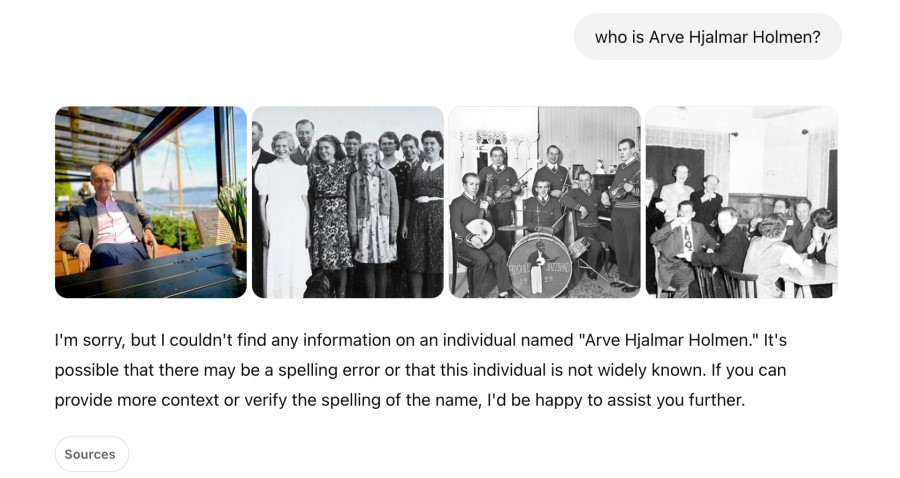

ChatGPT trả lời bằng một kết hợp hiển thị một số ảnh của những người khác nhau, dường như có nguồn từ các trang web bao gồm Instagram, SoundCloud và Discogs, cùng với văn bản tuyên bố rằng nó "không thể tìm thấy bất kỳ thông tin nào" về một cá nhân có tên đó.

ChatGPT trả lời bằng một kết hợp hiển thị một số ảnh của những người khác nhau, dường như có nguồn từ các trang web bao gồm Instagram, SoundCloud và Discogs, cùng với văn bản tuyên bố rằng nó "không thể tìm thấy bất kỳ thông tin nào" về một cá nhân có tên đó.

Đây không phải lần đầu tiên ChatGPT gây ra những vụ việc nghiêm trọng. Trước đó, AI này từng tạo ra những tuyên bố sai lệch về một chính trị gia Úc, cáo buộc ông liên quan đến một vụ bê bối tham nhũng, hay một nhà báo Đức bị gán tội danh lạm dụng trẻ em. Những thông tin sai lệch này có thể gây tổn hại danh dự, uy tín và thậm chí ảnh hưởng đến công việc, cuộc sống của những người bị nhắc đến.

Trước những cáo buộc, đại diện OpenAI cho biết công ty đang tiếp tục nghiên cứu các phương pháp cải thiện độ chính xác của mô hình và giảm thiểu "ảo giác AI". OpenAI cũng khẳng định rằng phiên bản ChatGPT hiện tại đã được nâng cấp với khả năng tìm kiếm thông tin trực tuyến, giúp cải thiện độ chính xác so với trước.

Dù vậy, tổ chức Noyb và cá nhân nạn nhân vẫn lo ngại rằng những thông tin sai lệch về họ có thể vẫn tồn tại trong hệ thống AI của OpenAI. Luật sư Kleanthi Sardeli của Noyb nhấn mạnh: "Không thể chỉ đơn giản thêm một dòng tuyên bố rằng thông tin có thể sai rồi coi như hoàn thành nghĩa vụ pháp lý. Nếu không có biện pháp ngăn chặn triệt để, AI có thể tiếp tục gây tổn hại danh dự và uy tín của nhiều người khác."

Vụ kiện này đặt ra câu hỏi lớn về trách nhiệm của các công ty AI trong việc bảo đảm tính chính xác của thông tin, đặc biệt là thông tin liên quan đến danh dự cá nhân. Khi công nghệ AI phát triển mạnh mẽ, người dùng cần thận trọng hơn khi tiếp cận và sử dụng thông tin từ các chatbot AI. Đồng thời, các cơ quan quản lý cũng cần có các biện pháp giám sát chặt chẽ hơn để đảm bảo quyền lợi của công dân không bị xâm phạm bởi những "ảo giác" nguy hiểm của AI.

Với mức độ nghiêm trọng của vụ việc lần này, có thể thấy rằng việc siết chặt quản lý các hệ thống AI như ChatGPT không còn là lựa chọn mà là một yêu cầu cấp thiết.

Duy Trinh (theo TechCrunch)